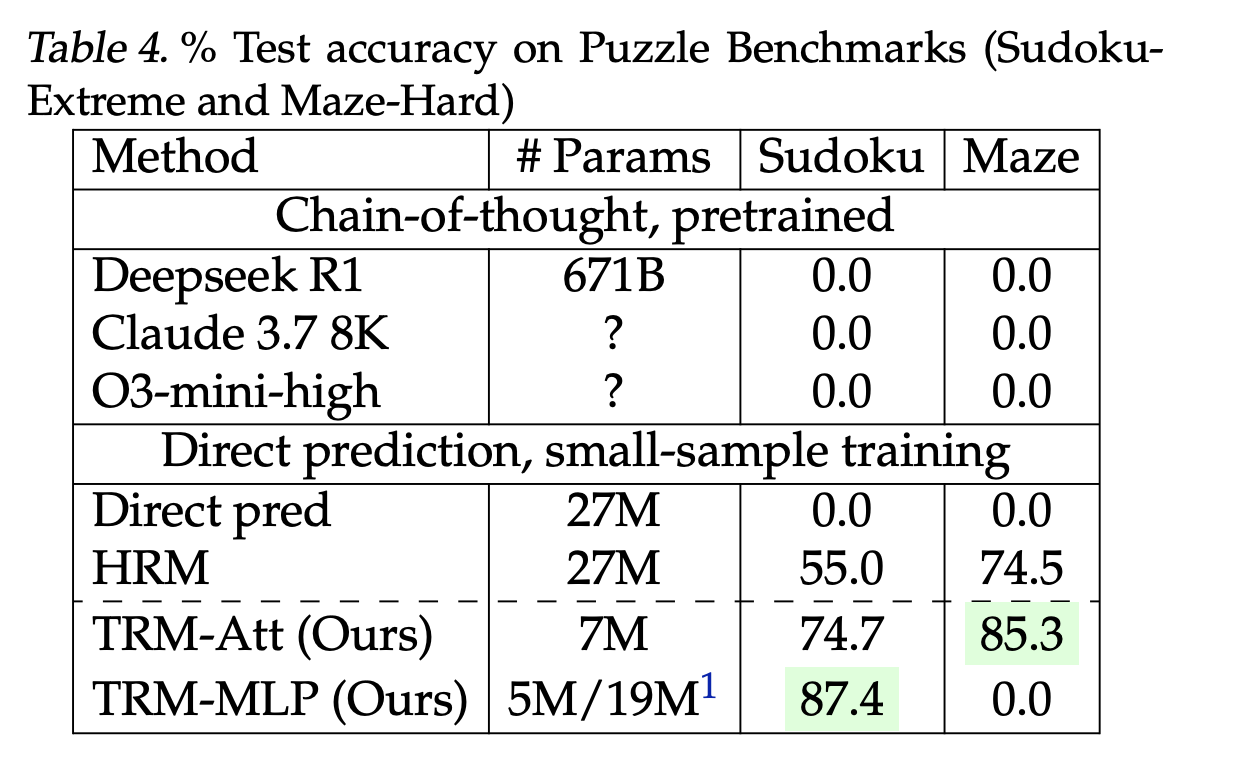

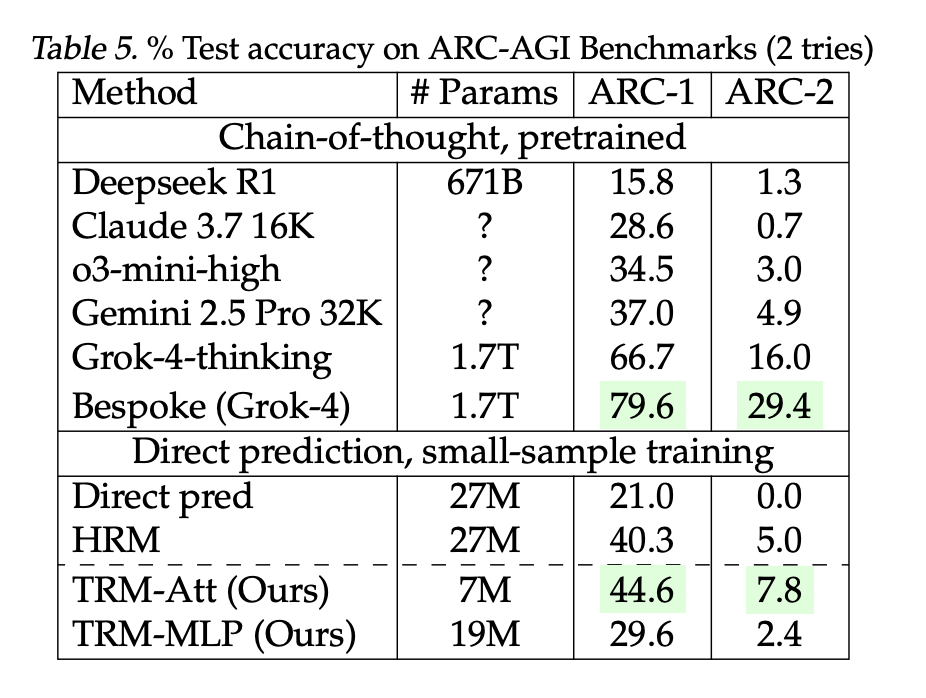

هل يمكن لنموذج مُتكرر يعتمد على التنقيح المتتالي والتحديث المستمر لـ "مساحة العمل المؤقتة" (latent scratchpad) أن يتجاوز أداء نماذج اللغة الكبيرة (LLMs) التوليدية المتزايدة في مهام الاستدلال المعقدة مثل ARC-AGI؟ لقد أصدر باحثون من مركز سامسونج للبحوث المتقدمة (SAIT) في مونتريال نموذجاً جديداً يُدعى **النموذج المُتكرر المصغر (TRM)**. هذا النموذج، الذي يمتلك حوالي 7 ملايين مُعامل فقط ومكون من طبقتين، حقق نتائج مذهلة، مسجلاً دقة تصل إلى **44.6–45%** في مجموعة بيانات **ARC-AGI-1** وحوالي **7.8–8%** في **ARC-AGI-2**. اللافت للنظر أن هذه النتائج تتفوق على ما سجلته نماذج لغوية أكبر حجماً بكثير، مثل DeepSeek-R1، وGemini 2.5 Pro، وo3-mini، عند تقييمها على نفس المقاييس العامة. علاوة على ذلك، نجح TRM في تحسين أداء المعايير المعيارية الأخرى مثل Sudoku-Extreme (بواقع 87.4%) وMaze-Hard (بواقع 85.3%) مقارنةً بالنموذج السابق HRM (27 مليون مُعامل)، وذلك باستخدام عدد أقل بكثير من المعاملات ووصف تدريبي أبسط.

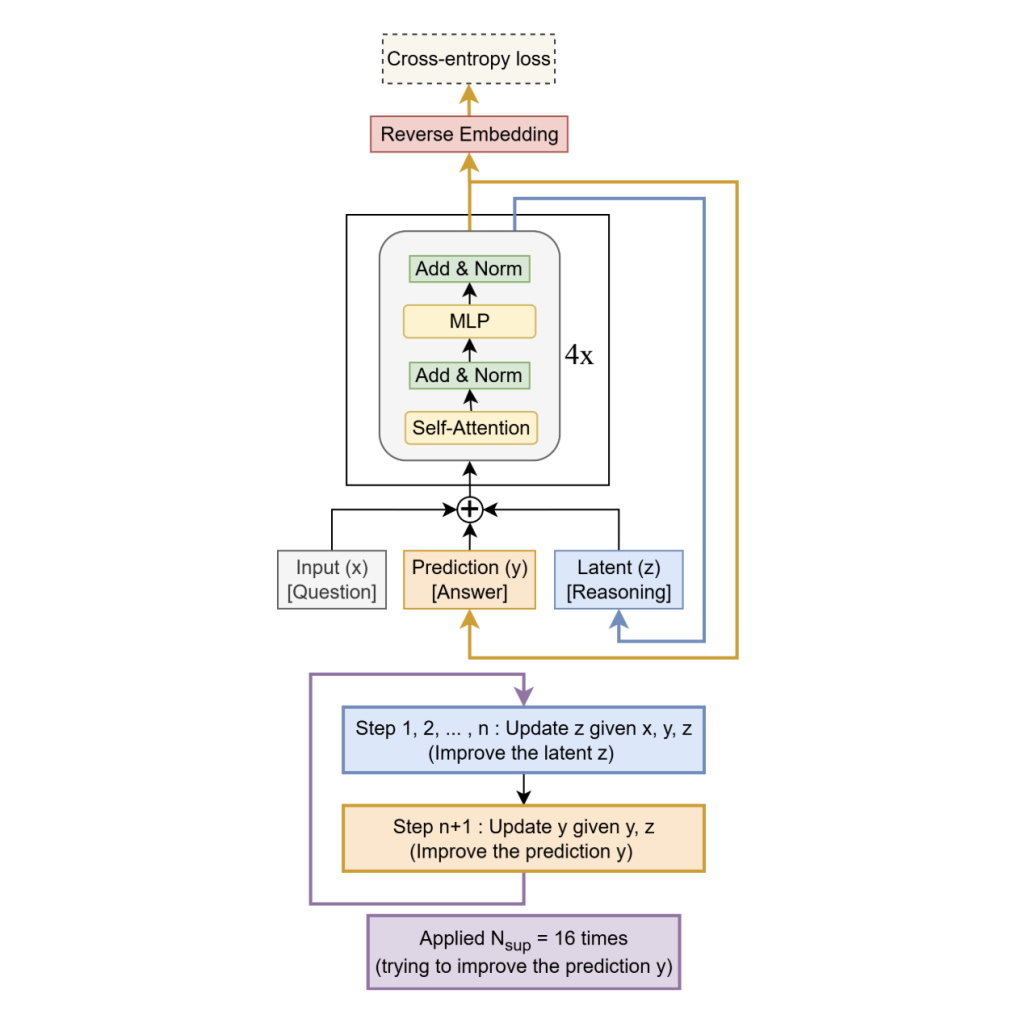

- ✅ استخدام نواة مُتكررة مصغرة تحل محل التسلسل الهرمي ثنائي الوحدات، حيث تقوم بتحديث "مساحة العمل المؤقتة" (z) و "تضمين الحل الحالي" (y) بشكل مشترك عبر دورات "التفكير" و "التنفيذ".

- ✅ تطبيق الإشراف العميق عبر فك تكرار كتلة التفكير/التنفيذ حتى 16 مرة، مع رأس إيقاف مُكتسب أثناء التدريب لتعزيز التعميم.

- ✅ إجراء الانتشار الخلفي الكامل عبر جميع خطوات التكرار، على عكس نموذج HRM الذي استخدم تقريباً تقريبياً لتقدير التدرج (fixed-point approximation)، مما ثبت أنه حاسم لتعميم TRM.

ما الجديد تحديداً في بنية TRM؟

أزال نموذج TRM الهيكل الهرمي المكون من وحدتين الذي كان يعتمد عليه نموذج HRM، بالإضافة إلى إزالة تقريب التدرج ذي النقطة الثابتة. وبدلاً من ذلك، يعتمد TRM على **شبكة واحدة صغيرة ومتكررة** تقوم بالتكرار على **"مساحة عمل مؤقتة" كامنة (z)** و **تضمين الحل الحالي (y)**. تتناوب العملية بين مرحلتين: مرحلة "التفكير" التي تقوم بتحديث $z \leftarrow f(x, y, z)$ لعدد $n$ من الخطوات الداخلية، ثم مرحلة "التنفيذ" التي تقوم بتحديث $y \leftarrow g(y, z)$. يتم فك تكرار كتلة التفكير/التنفيذ هذه لما يصل إلى 16 مرة مع إشراف عميق ورأس إيقاف مُتعلَّم أثناء التدريب، بينما يتم استخدام التفكيك الكامل في وقت الاختبار. تُعد قدرة النموذج على حمل الإشارات عبر الخطوات التكرارية عبر $(y, z)$ عنصراً محورياً في أدائه.

من الناحية المعمارية، تحتفظ الإعدادات الأكثر فعالية لمهام ARC/Maze بآلية **الانتباه الذاتي (self-attention)**. ولكن في مهام مثل Sudoku ذات الشبكات الثابتة الصغيرة، استبدل الباحثون الانتباه الذاتي بآلية **مُخلِّط (mixer) على غرار MLP-Mixer** لترميز الرموز. كما تم استخدام **متوسط متحرك أسي (EMA)** صغير على الأوزان لتحقيق استقرار التدريب عند استخدام بيانات محدودة. يتم إنشاء العمق الفعال للشبكة عبر **التكرار** (على سبيل المثال، $T = 3$ و $n = 6$) بدلاً من تكديس الطبقات؛ وأظهرت اختبارات الإزالة (ablations) أن **طبقتين** تحققان تعميماً أفضل من المتغيرات الأعمق بنفس القدرة الحاسوبية الفعالة.

فهم النتائج المذهلة

تُظهر النتائج تفوقاً واضحاً لنموذج TRM القائم على التكرار في مهام الاستدلال الرمزية مقارنةً بالنماذج الكبيرة التي تعتمد على فك التشفير التوليدي المتزايد (Autoregressive LLMs). تُذكر هذه النتائج كإنجازات تدريب مباشر (direct-prediction) وليست نتاج التلقين بلقطات قليلة (few-shot prompting). يجب ملاحظة أن هدف ARC-AGI يظل مفتوحاً، حيث أن عتبة الجائزة الكبرى لـ ARC-AGI-2 تتطلب دقة تصل إلى 85% على المجموعة الخاصة.

إذا كنت مهتماً بالاطلاع على الورقة البحثية الأصلية التي تشرح هذه الآلية، يمكنك زيارة الورقة التقنية الكاملة.

لماذا يمكن لنموذج 7 ملايين مُعامل التفوق على نماذج LLMs أكبر حجماً في هذه المهام؟

- القرار ثم التنقيح بدلاً من الرمز تلو الرمز: يقوم TRM بصياغة حل مرشح كامل، ثم يحسنه عبر **فحوصات اتساق تكرارية كامنة** مقابل المدخلات. هذا يقلل من "تحيز التعرض" (exposure bias) الناتج عن فك التشفير التوليدي المتزايد عند إنتاج مخرجات مهيكلة.

- استثمار القدرة الحاسوبية في الاستدلال (وقت الاختبار): ينشأ العمق الفعال من التكرار (حيث أن العمق المُحاكى يقارب $T \cdot (n+1) \cdot \text{layers}$)، وهو ما أثبت الباحثون أنه يحقق تعميماً أفضل عند ثبات القدرة الحاسوبية مقارنةً بإضافة طبقات. هذا يشير إلى أن عمق التكرار مهم للتعميم.

- انحياز استقرائي (Inductive Bias) مُحكم للاستدلال الشبكي: بالنسبة للشبكات الصغيرة والثابتة (مثل Sudoku)، يقلل مُخلِّط (mixer) الخالي من الانتباه من السعة الزائدة ويحسن المقايضات بين التحيز والتباين (bias/variance trade-offs)؛ مع الاحتفاظ بآلية الانتباه الذاتي للشبكات الأكبر (30x30).

ملخص النقاط الرئيسية من ورقة TRM

- **الهيكلية:** مُحلل مُتكرر بـ 7 ملايين مُعامل تقريباً، ومكون من طبقتين، يتناوب بين تحديثات "التفكير" الكامنة $z \leftarrow f(x, y, z)$ وتحديثات "التنفيذ" المُنقِّحة $y \leftarrow g(y, z)$، ويتم فك تكراره حتى 16 خطوة بإشراف عميق، مع نشر التدرجات عبر التكرار الكامل.

- **النتائج:** تحقيق نحو **44.6–45%** على **ARC-AGI-1** ونحو **7.8–8%** على **ARC-AGI-2 (محاولتان)**، متجاوزاً نماذج LLMs أكبر بكثير كما هو مذكور في المقارنات البحثية (مثل Gemini 2.5 Pro وDeepSeek-R1) وفقاً لبروتوكول التقييم المُعلن.

- **الكفاءة والنمط:** يُظهر أن تخصيص القدرة الحاسوبية لوقت الاختبار لعملية التنقيح المتكرر (العمق عبر الفك) يمكن أن يتغلب على قياس حجم المعاملات في المهام الرمزية-الهندسية، مقدماً وصفة بسيطة للتدريب من الصفر مع توفر الكود بشكل عام.

ما هي أهمية نموذج TRM للمستقبل؟

يُسلط هذا البحث الضوء على أن الاستدلال المُنظم والقائم على التكرار والتنقيح قد يوفر مساراً فعالاً لتعزيز قدرات **الاستدلال الرمزي** في النماذج الصغيرة، بدلاً من الاعتماد فقط على زيادة الحجم الهائل للمعاملات كما في نماذج LLMs التقليدية. إن تحقيق هذه المستويات من الأداء على ARC-AGI باستخدام 7 ملايين مُعامل فقط يفتح الباب أمام تطبيقات تتطلب قدرات استدلالية متقدمة بكفاءة عالية في الموارد.

كيف يمكنني الوصول إلى شفرة TRM المصدرية؟

أعلن فريق البحث عن إتاحة الكود الخاص بهم للجمهور على منصة جيت هب، مما يسمح للباحثين والمطورين بدراسة وتنفيذ البنية التكرارية المصغرة. للوصول المباشر إلى التنفيذ والموارد، يرجى النقر على الرابط أدناه.

ما هو الفرق الجوهري بين TRM ونموذج HRM السابق؟

الفرق الجوهري يكمن في طريقة التعامل مع التدرجات وعمق الشبكة. استبدل TRM التسلسل الهرمي المزدوج لـ HRM بشبكة واحدة متكررة، والأهم من ذلك، أنه يتجنب تقريب التدرج ذي النقطة الثابتة (Implicit Function Theorem - IFT) لـ HRM، وبدلاً من ذلك يطبق الانتشار الخلفي الكامل عبر جميع خطوات التكرار غير المقيدة، مما يُعتقد أنه السبب الرئيسي في قدرته المحسّنة على التعميم على مهام الاستدلال.

هل يتنافس TRM مع النماذج الكبيرة في المهام اللغوية العامة (مثل الكتابة الإبداعية)؟

لا، الهدف الأساسي لـ TRM ليس التفوق على النماذج اللغوية الكبيرة (LLMs) مثل Gemini أو GPT في مهام اللغة الطبيعية العامة التي تتطلب توليد نصوص طويلة ومعقدة غير مهيكلة. تم تدريب TRM خصيصاً على مهام الاستدلال الرمزية-الهندسية مثل ARC وSudoku، حيث يتفوق بسبب آليته التكرارية التي تحاكي عمليات التفكير والتحسين المتعددة التي تحتاجها هذه الألغاز.

🔎 في الختام، يمثل نموذج TRM المصغر دليلاً قوياً على أن كفاءة البنية الهندسية، المتمثلة في التكرار العميق القابل للتدريب الكامل عبر الانتشار الخلفي، يمكن أن تتفوق على الحجم المطلق للمعاملات في نطاقات محددة من الاستدلال المنطقي والهندسي. هذا التطور يفتح آفاقاً جديدة لتطوير نماذج ذكاء اصطناعي قادرة على التفكير المعمق والتحسين الذاتي بكفاءة موارد غير مسبوقة، مما يشير إلى أن الطريق إلى الذكاء الاصطناعي العام قد لا يمر فقط عبر التوسع، بل عبر الابتكار في تصميم آليات التعلم والتكرار.

قم بالتعليق على الموضوع